Redes sociais precisam de critérios claros de conteúdo contra coronavírus

Engin_Akyurt/ Pixabay

Começou a temporada de caça aos tuítes, postagens e mensagens que desinformam sobre o novo coronavírus. Nicolás Maduro sugeriu uma bebida caseira para combater a covid-19? A publicação foi apagada. Bolsonaro disse que "Graças a Deus o remédio está aí" enquanto visitava um açougue em Sobradinho? A publicação foi apagada. Regina Duarte se confundiu ao publicar o comunicado da Anvisa sobre a hidroxicloroquina? A postagem ganhou um aviso de que era "parcialmente falso". Em meio à pandemia, o WhatsApp limitou, mais uma vez, o envio de mensagens.

Tempos de crise pedem medidas enérgicas, certo? Mas o que será que mudou para fazer com que as empresas de internet começassem a adotar medidas mais rigorosas com relação ao conteúdo que circula em suas plataformas? E que lições podemos tirar dessa primeira leva de ações que foram adotadas para combater a desinformação relacionada ao covid-19?

O presidente Bolsonaro usualmente se refere às redes sociais como um instrumento de comunicação direta com o povo brasileiro, driblando assim a intermediação que a imprensa faz entre o que é dito e o que sai nos veículos de comunicação. A remoção de suas publicações no Twitter, no Facebook e no Instagram mostram que a realidade é bem diferente.

A internet não eliminou os intermediários na comunicação. Ela apenas os transformou. As empresas que administram as redes sociais são – como o próprio nome revela – "plataformas" sobre as quais os seus usuários criam e divulgam os mais diversos conteúdos. Elas atuam como intermediários do discurso e podem, a partir de regras pré-estabelecidas, gerir como esses textos, fotos e vídeos publicados na aplicação chegam (ou não) aos demais usuários.

Entra em cena então a questão das regras pré-estabelecidas. Que regras são essas? O que elas estipulam? Grande parte dos usuários das redes sociais e aplicativos em geral nunca leu os "Termos de Uso" das plataformas que usa todo santo dia. Esses documentos funcionam como um contrato entre o usuário e a empresa que administra a rede social.

Lá estão estipulados os comportamentos que podem levar à suspensão ou extinção de contas, além da remoção de postagens. Acontece que os termos dos Termos geralmente são genéricos. Como saber se uma nova postagem realmente viola o contrato celebrado com a rede social? E caso o post seja efetivamente removido, temos como saber qual foi exatamente a previsão contratual infringida?

É aqui que casos como os recentes servem para jogar luz no racional das empresas que administram redes sociais. As plataformas removem diariamente, como violações de seus Termos de Uso, conteúdos envolvendo pirataria, difamação, bullying e discurso de ódio, por exemplo. Às vezes fazem isso por determinação de uma ordem judicial, mas também atuam diretamente sobre o conteúdo porque o mesmo foi denunciado por outros usuários ou identificado pela própria empresa.

Quando é um juiz que ordena a remoção do conteúdo fica mais fácil conhecer as razões que levaram à exclusão do conteúdo. Basta ler a decisão. Mas quando são as empresas que agem diretamente sobre um conteúdo alegadamente violador dos Termos de Uso podemos cair em um cenário de extrema opacidade.

O combate à desinformação relacionada ao coronavírus representa um campo de testes importante para a forma pela qual as empresas gerem a remoção de conteúdos em suas plataformas e como essas medidas podem ser mais transparentes, previsíveis e auditáveis. Dada a crise global sobre o tema, várias empresas atualizaram as suas políticas para enfrentar o surto de informações falsas, desencontradas e maliciosas que rodam em suas plataformas.

Remover uma publicação de um presidente, como aconteceu com Maduro e Bolsonaro, não é uma decisão simples. O alcance de suas contas e a representatividade do cargo faz com que se questione se presidentes e demais autoridades nas redes sociais devem ou não ser tratados como qualquer outro usuário. Além disso, não faltaram comentários nas mesmas redes sociais apontando que outros governantes de outros países já fizeram pior, inclusive ameaçando bombardear países inimigos. E suas postagens não foram removidas.

Então algo mudou na postura das empresas, que agora passaram a aplicar com mais rigor as condições dos seus próprios "Termos de Uso". Mas será que essa mudança veio para ficar? Ou assim que a crise do coronavírus acabar voltaremos ao mesmo regime de opacidade e subjetividade?

Se assim for, as empresas podem vir a desperdiçar uma rara segunda chance de começar de novo e de se associar a um momento em que o mundo todo, por necessidade, olha para a internet não como a causadora de todos os males, que deseduca crianças, acoberta criminosos e descarrilha democracias.

Hoje é a internet que, em tempos de isolamento social, possibilita a comunicação entre familiares e amigos. É na rede que muitas empresas puderam transformar a rotina de seus funcionários, que agora trabalham remotamente. O próprio Poder Público, nas mais diferentes esferas, migrou para sessões e reuniões não presenciais.

As redes sociais e aplicativos de mensagem podem ser lembrados como parte da solução, e não como parte do problema, se acertarem a mão na forma pela qual combatem a desinformação sobre a covid-19 em suas plataformas. Mas isso apenas será possível se elas aplicarem as suas próprias regras com mais transparência, consistência e previsibilidade.

O próprio Facebook publicou recentemente um white paper chamado "Regulação de Conteúdo Online" assinado pela sua vice-presidente para políticas de conteúdo, Monika Bickert. Ali a empresa sugere que uma das soluções para o futuro da gestão de conteúdos em plataformas é uma espécie de "transparência procedimental" (procedural accountability). Segundo o documento, um modelo de regulação baseado em "transparência procedimental" poderia incluir, no mínimo, requisitos para que as empresas publiquem seus padrões de controle de conteúdo, possuam ferramentas para que as pessoas possam reportar à empresa qualquer conteúdo que viole esses padrões, além de oferecer uma efetiva resposta para essas notificações. Outras medidas também são indicadas como a criação de um modelo de recursos sobre a decisão de remover ou manter uma postagem, além da publicação de relatórios periódicos sobre pedidos de remoção.

Essas medidas são importantes porque ajudam a criar um piso sobre o qual diferentes plataformas podem desenvolver modelos distintos de notificação, recurso e transparência. Mas vale lembrar que todas essas resoluções apenas vão funcionar se existir não apenas transparência, mas também consistência na sua aplicação. Uma parte importante dessa guinada procedimental recai na capacidade das empresas em fazer valer a todo momento aquilo que elas mesmo prometeram fazer.

Uma regra de ouro da prática contratual é nunca escrever em um contrato algo que, na largada, você tem dúvidas se vai conseguir cumprir integralmente. Por mais bonita que seja a cláusula, o instrumento contratual não é o lugar para declarações positivas, porém descompromissadas. Ao contrário, é sempre importante questionar se aquilo que se espera cumprir pode efetivamente ser entregue e exigido.

Consistência passa também pelo questionamento sobre o que aconteceria se os termos do contrato valessem para uns e não para outros. Tome o exemplo de um contrato de trabalho. Qual é o efeito ao se demitir um funcionário que violou as regras da empresa quando se sabe que outros tantos também já haviam praticado a mesma conduta? A punição seletiva, em casos assim, além de não terminar bem no Judiciário também dissemina a desconfiança sobre o critério para a aplicação das normas.

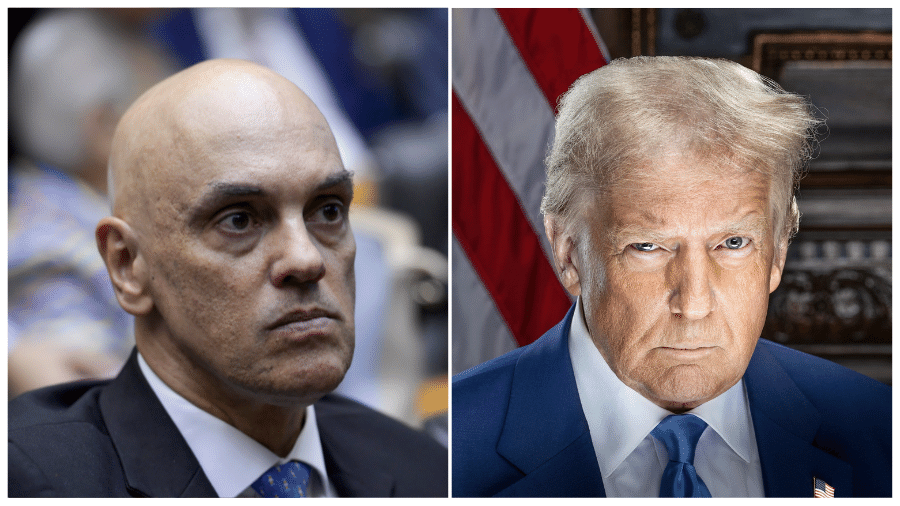

No caso do combate ao coronavírus se torna ainda mais importante entender quais são os critérios de moderação de conteúdos, especialmente quando um tema de natureza científica, como o uso da hidroxicloroquina no tratamento de pacientes com covid-19 ganha contornos políticos. Só assim vai ser possível avaliar a consistência dos sistemas de moderação, ainda mais quando outras autoridades também compartilharam textos e videos na mesma direção. O conteúdo abaixo, por exemplo, foi um dos comentários positivos sobre o medicamento retuitados pelo presidente americano Donald Trump.

As redes sociais não precisam de mais gente desconfiando dos seus critérios e apontando vieses a cada remoção de conteúdos e de contas que afetam esse ou aquele espectro político-ideológico. Uma saída para esse estado de perene desconforto envolve a "transparência procedimental" na aplicação das suas próprias regras de modo consistente, auditável (e quiçá colaborativo, como algumas estão fazendo ao terceirizar a checagem de fatos). Em tempos de tamanhas confusões e incertezas nos mais diferentes aspectos de nossas vidas, o remédio parece passar – até para os dilemas das redes sociais – por mais protocolo e previsibilidade.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.